一 : A5营销:网站Robots.txt协议,你懂多少?

网站Robots.txt文件,是网站与搜索引擎交流的通用协议,通过Robots协议的设置告诉搜索引擎哪些页面可以抓取,哪些页面不能抓取:一方面可以做网站安全的防护,更重要的是用来做优化,减少无效页面的收录,提升站点的排名效果。

但是在实际的操作中,绝大多数的网站,在其撰写上都存在或多或少的欠缺,甚至由于技术性的错误撰写,还会导致网站降权、不收录、被K等一系列问题的出现。对于这一点,A5营销,包括我,在对客户的SEO诊断过程中,会经常遇到,可以算是很多站点的通病。今天写出这篇文章,就是来做一个分享:关于robots.txt协议,你写对了吗?

一:设置成Allow全站点抓取

百度收录的越多,网站的排名越高?这是绝大多数站长的认为,事实上也是如此。但是也并非绝对成立:低质量的页面收录,会降低网站的排名效果,这一点你考虑到了吗?

如果你的网站结构不是非常的清晰,以及不存在多余的“功能”页面,不建议对网站开全站点的抓取,事实上,在A5的SEO诊断中,只遇到极少数的一部分网站,可以真正的做到全站点都允许抓取,而不做屏蔽。随着功能的丰富,要做到允许全站点抓取,也不太可能。

二:什么样的页面不建议抓取

对于网站功能上有用的目录,有用的页面,在用户体验上可以得到更好的提升。但是搜索引擎方面来讲,就会造成:服务器负担,比如:大量的翻页评论,对优化上则没有任何的价值。

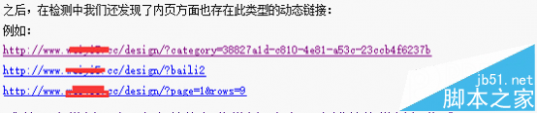

除此外还包含如:网站做了伪静态处理后,那么就要将动态链接屏蔽掉,避免搜索引擎抓取。用户登录目录、注册目录、无用的软件下载目录,如果是静态类型的站点,还要屏蔽掉动态类型的链接Disallow: /*?* 为什么呢?我们举个例子来看:

上面是某客户网站发现的问题,被百度收录的原因是:有人恶意提交此类型的链接,但是网站本身又没有做好防护。

三:撰写上的细节注意事项

方法上来讲,绝大多数的站长都明白,这里就不做多说了,不明白的站长,可以上百度百科看一下。今天这里说一些不常见的,可能是不少站长的疑问。

1、举例:Disallow; /a 与Disallow: /a/的区别,很多站长都见过这样的问题,为什么有的协议后加斜杠,有的不加斜杠呢?笔者今天要说的是:如果不加斜杠,屏蔽的是以a字母开头的所有目录和页面,而后者代表的是屏蔽当前目录的所有页面和子目录的抓取。

通常来讲,我们往往选择后者更多一些,因为定义范围越大,容易造成“误杀”。

2、JS文件、CSS需要屏蔽吗?不少网站都做了这个屏蔽,但是笔者要说的是:google站长工具明确的说明:封禁css与js调用,可能会影响页面质量的判断,从而影响排名。而对此,我们做了一些了解,百度方面同样会有一定影响。

3、已经删除的目录屏蔽,很多站长往往删除一些目录后,怕出现404问题,而进行了屏蔽,禁止搜索引擎再抓取这样的链接。事实上,这样做真的好吗?即使你屏蔽掉了,如果之前的目录存在问题,那么没有被蜘蛛从库中剔除,同样会影响到网站。

建议最佳的方式是:将对应的主要错误页面整理出来,做死链接提交,以及自定义404页面的处理,彻底的解决问题,而不是逃避问题。

上文为A5站长网:SEO项目经理(贺贵江wechat:senske)公益分享,我们每一个人在成长的过程中,都会遇到一些坎,找对了方向,就解决了问题,如果找不对方向,做的也是适得其反。

本次公益分享就这么多,如果您的网站迫切需要解决问题,请联系A5营销http://www.admin5.cn/seo/zhenduan/ SEO诊断服务,我在等你,为企业提供新动力!

二 : Robots.txt协议对网站优化有什么影响?

网站Robots.txt文件,是网站与搜索引擎交流的通用协议,通过Robots协议的设置告诉搜索引擎哪些页面可以抓取,哪些页面不能抓取:一方面可以做网站安全的防护,更重要的是用来做优化,减少无效页面的收录,提升站点的排名效果。

但是在实际的操作中,绝大多数的网站,在其撰写上都存在或多或少的欠缺,甚至由于技术性的错误撰写,还会导致网站降权、不收录、被K等一系列问题的出现。对于这一点,在对客户的SEO诊断过程中,会经常遇到,可以算是很多站点的通病。今天写出这篇文章,就是来做一个分享:关于robots.txt协议,你写对了吗?

一:设置成Allow全站点抓取

百度收录的越多,网站的排名越高?这是绝大多数站长的认为,事实上也是如此。但是也并非绝对成立:低质量的页面收录,会降低网站的排名效果,这一点你考虑到了吗?

如果你的网站结构不是非常的清晰,以及不存在多余的“功能”页面,不建议对网站开全站点的抓取,事实上,在A5的SEO诊断中,只遇到极少数的一部分网站,可以真正的做到全站点都允许抓取,而不做屏蔽。随着功能的丰富,要做到允许全站点抓取,也不太可能。

二:什么样的页面不建议抓取

对于网站功能上有用的目录,有用的页面,在用户体验上可以得到更好的提升。但是搜索引擎方面来讲,就会造成:服务器负担,比如:大量的翻页评论,对优化上则没有任何的价值。

除此外还包含如:网站做了伪静态处理后,那么就要将动态链接屏蔽掉,避免搜索引擎抓取。用户登录目录、注册目录、无用的软件下载目录,如果是静态类型的站点,还要屏蔽掉动态类型的链接Disallow: /*?* 为什么呢?我们举个例子来看:

上面是某客户网站发现的问题,被百度收录的原因是:有人恶意提交此类型的链接,但是网站本身又没有做好防护。

三:撰写上的细节注意事项

方法上来讲,绝大多数的站长都明白,这里就不做多说了,不明白的站长,可以上百度百科看一下。今天这里说一些不常见的,可能是不少站长的疑问。

1、举例:Disallow; /a 与Disallow: /a/的区别,很多站长都见过这样的问题,为什么有的协议后加斜杠,有的不加斜杠呢?笔者今天要说的是:如果不加斜杠,屏蔽的是以a字母开头的所有目录和页面,而后者代表的是屏蔽当前目录的所有页面和子目录的抓取。

通常来讲,我们往往选择后者更多一些,因为定义范围越大,容易造成“误杀”。

2、JS文件、CSS需要屏蔽吗?不少网站都做了这个屏蔽,但是笔者要说的是:google站长工具明确的说明:封禁css与js调用,可能会影响页面质量的判断,从而影响排名。而对此,我们做了一些了解,百度方面同样会有一定影响。

3、已经删除的目录屏蔽,很多站长往往删除一些目录后,怕出现404问题,而进行了屏蔽,禁止搜索引擎再抓取这样的链接。事实上,这样做真的好吗?即使你屏蔽掉了,如果之前的目录存在问题,那么没有被蜘蛛从库中剔除,同样会影响到网站。

建议最佳的方式是:将对应的主要错误页面整理出来,做死链接提交,以及自定义404页面的处理,彻底的解决问题,而不是逃避问题。

三 : 浅谈robots.txt机器人协议的使用小技巧

刚写了一篇文回忆了新站长们优化过程中容易犯下的小错误,中间提到了robots.txt机器人协议,不禁就想跟大家讨论一下robots.txt机器人协议的使用技巧。网站优化是个长期的工作,同时也是一个互动的工作,闭门造车的站长不会是一个好站长,所以希望大家能多多交流。不足之处,请斧正。

废话不多说,咱们开始进入正题。robots.txt机器人协议大家都知道是为了规范蜘蛛爬行而设定的,大家一般会在其中常规性的禁止蜘蛛爬行data、tmp这些目录,也会禁止其爬行会员、订单、库存等等模块。但除了这些常规用法之外,robots.txt机器人协议对我们优化工作其实,还有很多小技巧可以配合使用,让我们的网站优化工作更好进行。

一、通过禁止爬行动态页或某些页面,减少重复收录

首先就是很多人都知道的禁止蜘蛛爬行动态页,减少整个网站的重复收录问题。好处就是利于整个网站内容页面的权重集中,不容易因为重复收录导致内容页面权重分散等等。这是这个技巧对与常规网站的一般意义,但是对于商城站、资讯站、问答站等大型网站,这种规范意义却是十分大的。

1、商城、B2B等大型网站条件过滤页

在商城、B2B等大型网站中,常常会涉及到条件过滤的问题,即通过删选产品的规格、品牌等会出现大量相似页面。假如这个问题不能有效解决就会造成网站大量相似内容被重复收录等等,一般而言这种问题可以通过运用应针对行的进行一些URL屏蔽工作,或者考虑采用ajax形式。但效果而言,没有直接使用robots.txt机器人协议效果好,推荐还是在URL静态化规则做好的基础上通过robots.txt禁止抓取动态页面来进行处理。

2、资讯站评论页面

资讯站页面评论跟条件过滤页相似,也需要通过robots.txt配合URL规则设置屏蔽掉动态页面,防止重复收录等问题。

3、其他类似情况

在B2B、招聘、威客网站当中也会有类似的问题,这些情况都可以使用robots.txt来有效的规范蜘蛛爬行,从而规避重复收录等等。

二、诱导蜘蛛爬行重要页面,提高蜘蛛爬行效率

这个小技巧主要是配合网站地图和聚合页标签使用,为的是给这些重要页面提供更多入口方便蜘蛛爬行。网站地图、聚合页标签伪装的列表页等等是蜘蛛爬行最为快捷方便的地方,通过robots.txt协议中Allow命令的使用,让蜘蛛优先爬行这些页面,自然收录情况也就更好。

三、调整网站权重分配

通过robots.txt协议可以有效的调整网站的整体权重,配合nofflow标签等使用将权重导向网站的重点栏目或者重点页面,达到合理分配整站权重的作用。

四、擦边球做法

在提高网站相关度的一种首发中,就是利用robots.txt协议。其在根目录中防置大量的TXT文档,在TXT文档中嵌入大批量的关键词,然后通过robots.txt诱导蜘蛛去爬行这些目录。当然这里不是让大家也这么做,毕竟黑帽手段不长久,咱们说的是安全的小技巧。

这里不知道有没有站长的网站被挂马过,特别是被寄生虫肆虐过的站长更是很悲愤吧。不过咱们换个思路看,寄生虫这种方法,也未尝不是我们做网页收录的一个好办法。即通过设计一些页面模版,然后通过程序批量生成大量页面,将这些页面按照规则放置到对应的新目录中,通过robots.txt诱导蜘蛛爬行,收录效果也很不错。当然,这种手段做的话,页面模版必须做的很优秀才可以,不然将会很大的影响用户体验,希望站长们注意。

本文标题:robots.txt协议-A5营销:网站Robots.txt协议,你懂多少?61阅读| 精彩专题| 最新文章| 热门文章| 苏ICP备13036349号-1